Prédiction de l'Innovation Scientifique par Modélisation Hypergraphique et IA

Reproduction, extension et amélioration d'un modèle hypergraphique publié dans Nature Communications pour mesurer l'innovation dans …

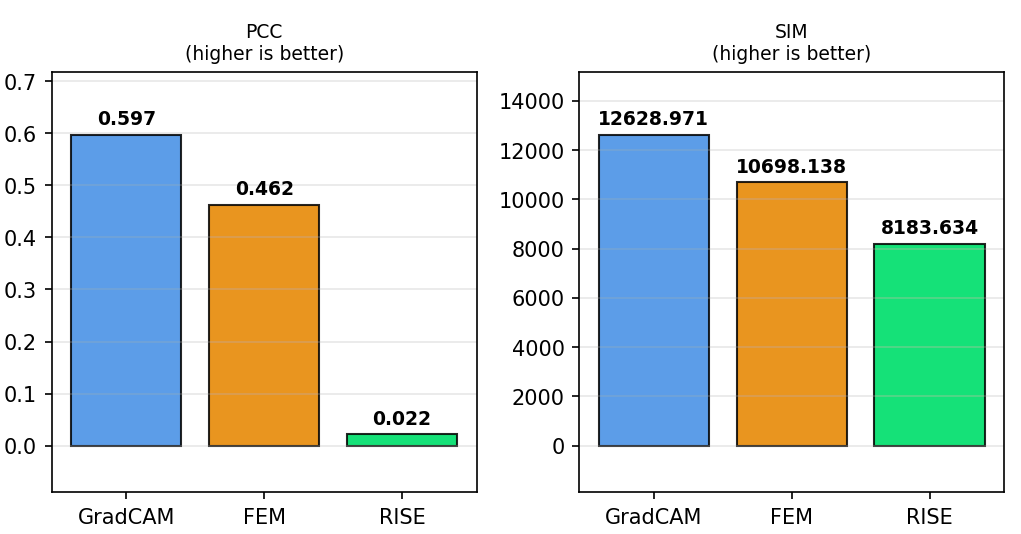

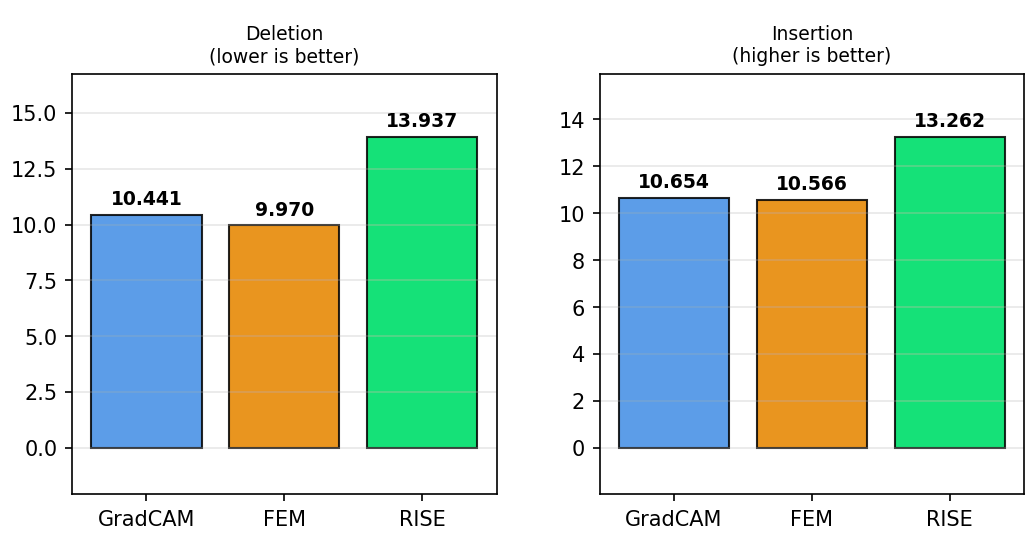

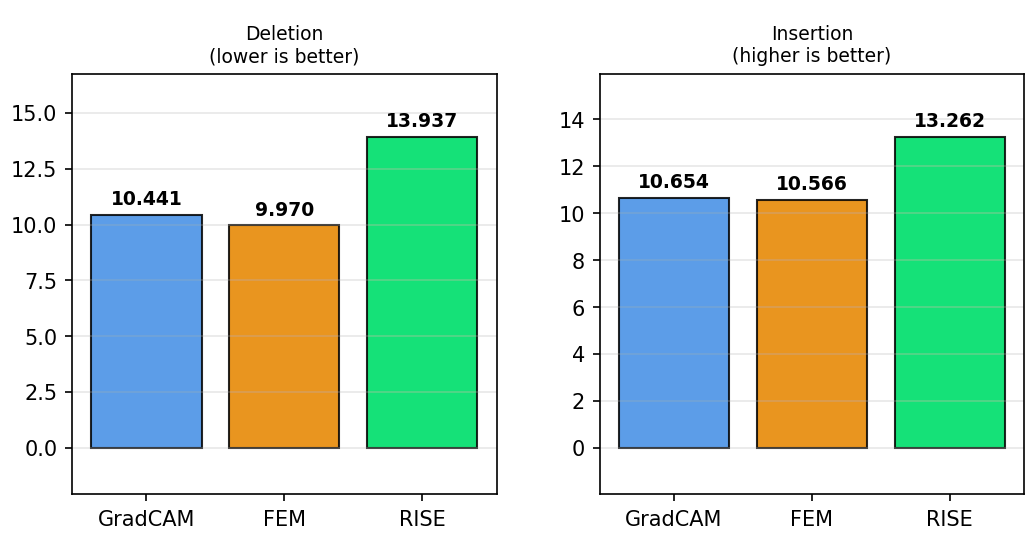

Ce projet évalue et compare trois méthodes d'explicabilité (XAI) appliquées à un ResNet-18 pré-entraîné sur le dataset MexCulture142, composé d'images de sites patrimoniaux mexicains annotées avec des données de fixation oculaire humaine. Chaque méthode génère une carte de saillance indiquant les régions de l'image les plus déterminantes pour la décision du modèle, évaluée contre des Gaussian Fixation Density Maps (GFDM) comme ground truth. Grad-CAM exploite les gradients de la classe prédite par rapport à la dernière couche convolutive (layer4[-1]), produisant une carte discriminante sans modification du modèle. FEM identifie les canaux fortement activés via un seuillage k-sigma (mean + k×std), en préservant l'intensité des activations pour une carte plus fidèle à l'énergie des features. RISE adopte une approche black-box en générant 4 000 masques binaires aléatoires et en construisant la carte comme une somme pondérée par la confiance du modèle. Les résultats sont évalués selon quatre métriques : PCC, SIM, Deletion AUC et Insertion AUC. Grad-CAM obtient le meilleur alignement avec l'attention humaine (PCC=0.597), FEM identifie le mieux les pixels critiques pour le modèle (Deletion=9.97), tandis que RISE, bien que model-agnostic, ne corrèle pas avec la perception humaine sur des images architecturales (PCC=0.022), ce qui s'explique par la nature diffuse du signal de classification sur ce type de scènes. Pour une description complète, consultez le README sur GitHub.